|

Cecha Charakterystyczna |

Era Pary / |

Era Napędu Grupowego |

Era Napędu Jednostkowego / RAG + Agenci |

|---|---|---|---|

|

Źródło Energii / Wiedzy |

Centralny kocioł / Model LLM (Publiczny) |

Wielkie dynamo / Model LLM (Private Cloud) |

Rozproszone silniki / RAG + Baza Wiedzy |

|

Mechanizm Transmisji |

Wały, pasy, koła pasowe / Chatboty generyczne |

Kable do centralnego silnika / API do LLM |

Bezpośrednie wpięcie w proces / Agenci AI |

|

Elastyczność Układu |

Sztywna, liniowa / Sztywne zapytania-odpowiedzi |

Ograniczona / Skrypty automatyzujące |

Całkowita / Adaptacyjne systemy agentowe |

|

Główny Problem |

Tarcie i straty mocy / Halucynacje i brak kontekstu |

Wysoki koszt stały / "Podatek od wdrożenia" |

Złożoność orkiestracji / Zarządzanie zaufaniem |

|

Poziom Produktywności |

Początkowy wzrost, potem stagnacja |

Paradoks produktywności |

Skokowy wzrost (po transformacji struktury) |

Architektura Nowej Wydajności: Od „Cyfrowej Pary” do Rewolucji RAG i Agentów AI

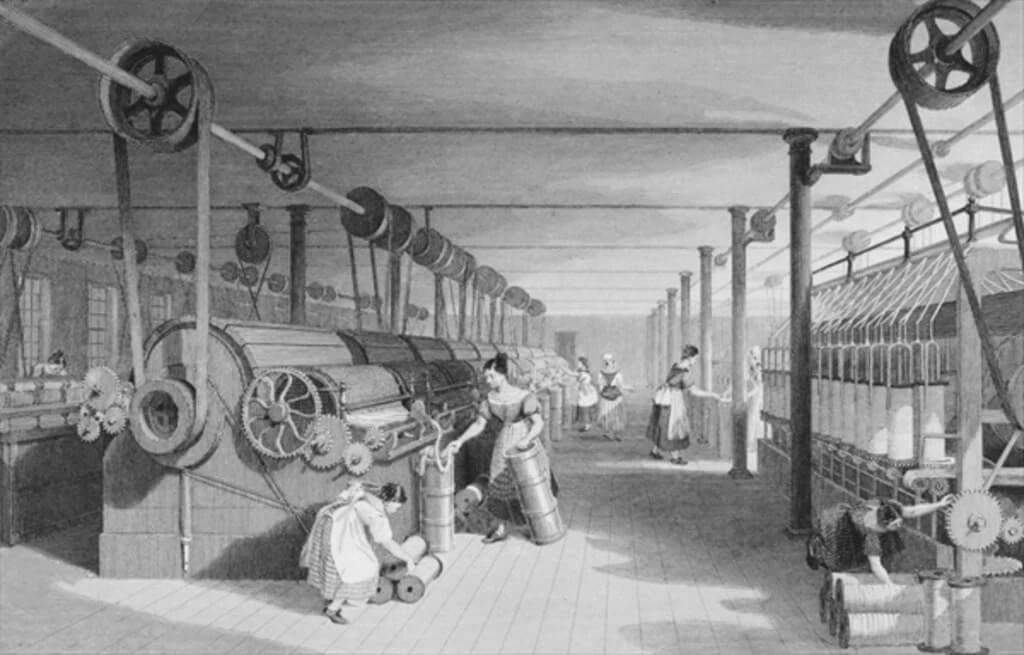

Współczesny krajobraz technologiczny znajduje się w punkcie krytycznym, który historycy ekonomii i analitycy rynkowi coraz częściej określają mianem "nowoczesnego paradoksu produktywności AI". Mimo masowych inwestycji w generatywną sztuczną inteligencję, wskaźniki makroekonomiczne oraz jednostkowe wyniki finansowe wielu przedsiębiorstw nie wykazują jeszcze oczekiwanego, gwałtownego przełomu. Sytuacja ta do złudzenia przypomina dynamikę z przełomu XIX i XX wieku, kiedy to wprowadzenie energii elektrycznej do fabryk nie przyniosło natychmiastowych zysków, a wręcz spowodowało przejściowe spowolnienie wzrostu. Dopiero głęboka rekonfiguracja procesów, odejście od centralnych systemów napędowych na rzecz rozproszonych jednostek oraz precyzyjne osadzenie technologii w konkretnym kontekście pracy pozwoliło na uwolnienie pełnego potencjału rewolucji przemysłowej. W dzisiejszym kontekście biznesowym, tym brakującym ogniwem, które przekształca potężną, ale surową moc obliczeniową w precyzyjne narzędzie przewagi konkurencyjnej, jest technologia Retrieval-Augmented Generation (RAG) oraz automatyzacja procesów oparta na agentach AI.

Współczesny Paradoks Produktywności: Bariery Adaptacji AI

Analiza historyczna i współczesne dane ekonomiczne sugerują, że technologie ogólnego przeznaczenia (GPT – General Purpose Technologies), takie jak elektryczność czy obecnie sztuczna inteligencja, wymagają długiego okresu inkubacji i strukturalnego dostosowania, zanim ich wpływ na produktywność stanie się mierzalny na szeroką skalę. Obecnie obserwuje się zjawisko określane jako „podatek od wdrożenia” (Implementation Tax). Przykładowo, banki i instytucje finansowe adoptujące rozwiązania oparte na GenAI odnotowują przejściowy spadek rentowności kapitału własnego (ROE) o około 428 punktów bazowych w fazie absorpcji kosztów integracji i rekonfiguracji systemów.

Przyczyną tego stanu rzeczy jest fakt, że wczesne wdrożenia AI przypominają „centralny silnik parowy”. Jest on potężny, imponujący i zdolny do generowania ogromnej energii, ale pozostaje generyczny i odizolowany od specyficznych tkanek operacyjnych firmy. Tradycyjne modele językowe (LLM), choć dysponują ogromną wiedzą ogólną, działają w systemie „zamkniętej księgi”. Ich wiedza jest statyczna, ograniczona do daty zakończenia treningu (cutoff date) i pozbawiona specyficznego, poufnego kontekstu danej organizacji. W efekcie liderzy biznesowi stają przed problemem „halucynacji” – zjawiskiem, w którym model generuje wiarygodnie brzmiące, ale całkowicie błędne informacje, co w środowisku o wysokim rygorze decyzyjnym jest barierą krytyczną.

Poniższa tabela przedstawia porównanie obecnego etapu wdrażania AI z historycznymi fazami transformacji technologicznej, ilustrując ewolucję od centralizacji do rozproszenia:

Badania wskazują, że zaledwie 6% firm w pełni ufa agentom AI w zarządzaniu kluczowymi procesami biznesowymi. Ta nieufność nie wynika z braku wiary w inteligencję maszynową jako taką, lecz z braku precyzji i niemożności weryfikacji źródeł, co bezpośrednio hamuje skalowanie technologii poza fazę eksperymentalną.

Lekcja z Historii: Anatomia Przejścia od Pary do Elektryczności

Aby w pełni zrozumieć, dlaczego obecne podejście do AI wymaga radykalnej rewizji, należy przeanalizować ewolucję fabryki na przełomie wieków. W XIX wieku sercem zakładu produkcyjnego był gigantyczny silnik parowy. Moc mechaniczna była przekazywana do poszczególnych maszyn za pomocą niezwykle skomplikowanego systemu wałów transmisyjnych umieszczonych pod sufitem, połączonych z maszynami za pomocą skórzanych pasów i kół pasowych.

Ograniczenia Napędu Grupowego (Group Drive)

System ten, znany jako „group drive” (napęd grupowy), narzucał fabryce niezwykle sztywną architekturę, która determinowała nie tylko efektywność, ale i samą logikę pracy:

- Sztywność Geometryczna: Wszystkie maszyny musiały być ustawione w rzędach bezpośrednio pod wałami napędowymi. Uniemożliwiało to optymalizację przepływu materiałów zgodnie z logiką procesu produkcyjnego. Fabryki były projektowane pod dyktando inżynierii mechanicznej, a nie efektywności operacyjnej.

- Marnotrawstwo Energii: Cały system wałów musiał pracować, nawet jeśli uruchomiona była tylko jedna maszyna na końcu hali. Tarcie w systemie pasów i łożysk powodowało, że ogromna część energii cieplnej z węgla nigdy nie docierała do narzędzi pracy.

- Krytyczne Punkty Awarii: Awaria centralnego silnika parowego lub pęknięcie głównego pasa transmisyjnego natychmiastowo paraliżowało całą produkcję. Brak niezależności poszczególnych stanowisk tworzył system kruchym i podatnym na przestoje.

Kiedy na rynku pojawiły się pierwsze praktyczne silniki elektryczne (wynalazki Tesli, Edisona i Westinghouse'a), większość właścicieli fabryk popełniła błąd, który dzisiaj nazywamy "pułapką narzędziową". Zastąpili oni po prostu silnik parowy jednym, potężnym silnikiem elektrycznym, pozostawiając nienaruszony system wałów i pasów. Z perspektywy finansowej była to zmiana czysto kosmetyczna – wyeliminowano potrzebę składowania węgla i obsługi kotła, ale architektura pracy pozostała "parowa". Produktywność, ku zaskoczeniu ówczesnych liderów, nie wzrosła znacząco. To jest właśnie moment, w którym dziś znajduje się wiele firm wdrażających AI jako "nakładkę" na stare procesy.

Rewolucja Napędu Jednostkowego (Unit Drive)

Prawdziwy przełom, określany jako „unit drive” (napęd jednostkowy), nastąpił dopiero wtedy, gdy inżynierowie i managerowie zrozumieli, że siła silnika elektrycznego nie tkwi w jego skali, lecz w jego podzielności. Możliwość zamontowania małego, niezależnego silnika bezpośrednio na każdej maszynie zlikwidowała potrzebę istnienia centralnego wału.

Skutki tej zmiany były transformacyjne i wykraczały daleko poza czystą mechanikę:

- Optymalizacja Przepływu (Flow): Maszyny mogły zostać ustawione w dowolnej konfiguracji, co pozwoliło na narodziny nowoczesnych linii montażowych (np. u Henry'ego Forda).

- Poprawa Środowiska Pracy: Eliminacja pasów pod sufitem pozwoliła na zainstalowanie okien dachowych i lepszego oświetlenia, co drastycznie zmniejszyło liczbę wypadków i błędów.

- Skalowalność i Elastyczność: Każdą maszynę można było modernizować lub przestawiać niezależnie, bez wpływu na resztę zakładu.

Współczesne, generyczne modele AI są odpowiednikiem tego centralnego silnika parowego. Mogą być "doklejone" do organizacji przez okno przeglądarki (chatbot), ale ich moc jest tracona w "tarciu" procesowym – konieczności ręcznego kopiowania danych, weryfikowania błędów (halucynacji) i dopasowywania generycznych odpowiedzi do unikalnego kontekstu firmy.

RAG: Nadawanie AI „Gruntu pod Nogami” i Eliminacja Halucynacji

Technologia Retrieval-Augmented Generation (RAG) reprezentuje przejście od "cyfrowej pary" do "rozproszonego zasilania informacyjnego". Zamiast zmuszać model AI do polegania wyłącznie na jego statycznej pamięci treningowej (która jest jak ogromna, ale nieaktualna biblioteka), RAG wyposaża go w mechanizm "otwartej księgi".

Techniczny Mechanizm Groundingu

Proces ten, nazywany uziemieniem (grounding), jest kluczem do biznesowej wiarygodności AI. W architekturze RAG model nie generuje odpowiedzi bezpośrednio z "próżni" swoich parametrów. Zamiast tego, proces przebiega w trzech fazach:

- Ekstrakcja i Embedding: Dokumenty firmowe (polityki, instrukcje, raporty finansowe, logi wsparcia) są dzielone na fragmenty (chunks), zazwyczaj o długości od 200 do 500 tokenów, a następnie przekształcane w wektory matematyczne (embeddings) i przechowywane w specjalistycznej bazie wektorowej.

- Kontekstowe Pobieranie (Retrieval): Gdy użytkownik zadaje pytanie, system przeszukuje bazę wektorową w poszukiwaniu fragmentów najbardziej zbliżonych znaczeniowo do zapytania. Nie jest to wyszukiwanie słów kluczowych, lecz dopasowanie semantyczne.

- Augmentacja Promptu: Wybrane fragmenty są dołączane do zapytania wysyłanego do LLM. Model otrzymuje instrukcję: „Odpowiedz na pytanie, używając wyłącznie dostarczonych fragmentów tekstu. Jeśli informacji tam nie ma, przyznaj, że nie wiesz”.

Poniższa tabela porównuje efektywność RAG z tradycyjnym dotrenowaniem modelu (fine-tuning), wskazując na przewagi w zastosowaniach biznesowych:

|

Kryterium Porównawcze |

Fine-Tuning (Dostrajanie) |

RAG (Retrieval-Augmented Generation) |

|---|---|---|

|

Aktualność Danych |

Statyczna (wymaga ponownego treningu) |

Dynamiczna (aktualizacja bazy w czasie rzeczywistym) |

|

Prywatność i Bezpieczeństwo |

Trudne do kontrolowania w wagach modelu |

Precyzyjne uprawnienia na poziomie dokumentu |

|

Weryfikowalność (Traceability) |

Brak (model nie wie, skąd czerpie wiedzę) |

Pełna (cytowanie konkretnych źródeł i stron) |

|

Koszty Operacyjne |

Wysokie (wymaga GPU i ekspertów) |

Niskie/Średnie (koszt bazy wektorowej i API) |

|

Ryzyko Halucynacji |

Średnie/Wysokie |

Bardzo niskie (dzięki uziemieniu w faktach) |

|

Zastosowanie Idealne |

Zmiana stylu, tonu, nauka specyficznego żargonu |

Odpowiadanie na pytania o fakty i procedury |

Dzięki RAG, AI przestaje być "rozmarzonym poetą" (podatnym na halucynacje) i staje się "precyzyjnym analitykiem", który zawsze trzyma palec na konkretnym akapicie dokumentu źródłowego. W testach hybrydowych połączenie RAG z lekko dotrenowanym modelem pozwala na podniesienie dokładności o 11 punktów procentowych w porównaniu do modeli generycznych.

Od Chatbotów do Agentów: Nowa Architektura Wykonawcza

Sama wiedza (RAG) jest jedynie fundamentem. Aby w pełni zrealizować wizję "rozproszonych silników" (unit drive) w nowoczesnym przedsiębiorstwie, musimy przejść od systemów konwersacyjnych (chatbotów) do systemów wykonawczych – agentów AI.

Definicja i Autonomia Agentów

Agent AI to system, który nie tylko generuje tekst, ale wykazuje zdolność do rozumowania, planowania i autonomicznego podejmowania działań w celu osiągnięcia zdefiniowanego celu. O ile chatbot jest reaktywny, o tyle agent jest proaktywny. Może on korzystać z zewnętrznych narzędzi, wyszukiwać informacje w sieci, aktualizować rekordy w systemie CRM czy wysyłać zapytania do API.

W architekturze rozproszonej, zamiast jednego "wszystkowiedzącego" modelu, przedsiębiorstwa budują ekosystemy wielu agentów (Multi-Agent Systems - MAS), gdzie każdy z nich pełni rolę wyspecjalizowanego "silnika" na konkretnym stanowisku pracy :

- Specjalizacja Ról: Podobnie jak w fabryce oddzielny silnik napędza tokarkę, a inny pompę, w firmie jeden agent może odpowiadać za weryfikację zgodności (Compliance Agent), inny za optymalizację logistyki (Logistics Agent), a jeszcze inny za analizę nastrojów klientów.

- Koordynacja i Orkiestracja: Agenci komunikują się ze sobą za pomocą protokołów takich jak Contract Net Protocol (CNP), gdzie agent "menedżer" ogłasza zadanie, a agenci "wykonawcy" licytują jego realizację na podstawie swojej dostępności i kompetencji.

- Odporność Systemu: Awaria jednego agenta lub błąd w jednym procesie nie paraliżuje całej organizacji. Systemy te są modularne i zdolne do autokorekty poprzez pętle zwrotne (feedback loops), w których jeden agent recenzuje pracę drugiego.

To podejście bezpośrednio adresuje problem „tarcia” informacyjnego. Zamiast zmuszać pracowników do bycia „łącznikami” między systemami (co prowadzi do stresu i błędów wynikających z przełączania kontekstu), agenci przejmują deterministyczne i powtarzalne fragmenty workflowu, pozwalając ludziom na skupienie się na kreatywności i strategicznym osądzie.

Ekonomia Transformacji: Przezwyciężanie Krzywej J

Wdrażanie zaawansowanej architektury AI (RAG + Agenci) wiąże się z wyzwaniem ekonomicznym znanym jako "Krzywa J" adopcji technologii. W początkowej fazie, ze względu na wysokie koszty integracji, czyszczenia danych i szkolenia kadr, wskaźniki produktywności mogą przejściowo spaść, co zniechęca wielu liderów do kontynuowania inwestycji.

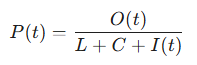

Wartość produktywności w czasie transformacji można opisać uproszczoną formułą:

Gdzie:

- P(t) - Produktywność w czasie t

- O(t) - Output (wynik operacyjny)

- L - Koszty pracy

- C - Koszty kapitałowe (technologia)

- I(t) - Nakłady na integrację i zmianę strukturalną (często niedoszacowane)

W fazie "Pary" (generyczne chatboty), I(t) jest niskie, ale O(t) również nie rośnie znacząco, ponieważ AI generuje błędy wymagające ludzkiej weryfikacji. W fazie "Elektryfikacji Jednostkowej" (RAG + Agenci), I(t) gwałtownie rośnie w krótkim terminie, co obniża P(t). Jednak po przekroczeniu punktu krytycznego, O(t) rośnie wykładniczo, a koszty operacyjne L ulegają optymalizacji, prowadząc do trwałej przewagi konkurencyjnej.

Bariery Zaufania i Gotowości Infrastrukturalnej

Według raportów Harvard Business Review, głównym hamulcem nie jest brak mocy obliczeniowej, lecz brak "zaufanych danych". Poniższa tabela przedstawia główne przeszkody w pełnym wdrożeniu autonomicznych systemów AI:

|

Bariera Adopcji |

Odsetek Wskazań (Liderzy IT) |

Strategiczne Rozwiązanie |

|---|---|---|

|

Prywatność i Cyberbezpieczeństwo |

31% - 43% |

Prywatne instancje modeli, lokalne bazy wektorowe |

|

Jakość i Wiarygodność Danych |

23% - 39% |

Wdrożenie technologii RAG i warstwy semantycznej |

|

Nieprzygotowane Procesy Biznesowe |

22% |

Reengineering procesów (BPR) zamiast prostej automatyzacji |

|

Ograniczenia Infrastruktury |

20% - 22% |

Inwestycja w Enterprise Orchestration i Data Fabric |

|

Brak Talentów i Kompetencji |

~30% |

Rozwijanie umiejętności EPOCH (Empathy, Presence, Creativity, etc.) |

Liderzy, którzy odnoszą sukcesy (tzw. "Leaders" w zestawieniu HBR), nie inwestują po prostu w większą liczbę agentów. Inwestują w fundamenty: ujednolicone repozytoria danych, governance (ład korporacyjny) oraz orkiestrację, która pozwala agentom działać w sposób bezpieczny i przewidywalny.

Nowa Definicja Pracy: Od Automatyzacji do Augmentacji

Ostatecznym celem przejścia na model "rozproszonych silników AI" nie jest zastąpienie ludzi, lecz fundamentalna zmiana struktury ich pracy. Badania MIT Sloan wskazują na konieczność rozróżnienia między automatyzacją (przeniesieniem zadania na maszynę) a augmentacją (zwiększeniem produktywności człowieka dzięki współpracy z technologią).

Framework EPOCH

W świecie nasyconym agentami AI, ludzka wartość przesuwa się w stronę zdolności, których modele matematyczne nie są w stanie (póki co) zreplikować. Badacze MIT określają to jako framework EPOCH :

- E (Empathy): Empatia i relacje międzyludzkie.

- P (Presence): Fizyczna obecność i interakcja społeczna.

- O (Opinion/Judgment): Wydawanie sądów moralnych, etycznych i strategicznych.

- C (Creativity): Kreatywność wykraczająca poza statystyczną syntezę danych.

- H (Hope/Leadership): Budowanie wizji, nadziei i motywowanie zespołów.

W fabryce zasilanej silnikami parowymi, robotnik był często tylko "dodatkiem" do maszyny, dostosowującym się do jej rytmu. W inteligentnym przedsiębiorstwie zasilanym przez RAG i agentów, technologia dostosowuje się do potrzeb pracownika, dostarczając mu precyzyjnych informacji w momencie decyzji (augmentation) i uwalniając go od nużącej administracji danych (automation).

Reengineering: Nie Automatyzuj, Unicestwiaj

W 1990 roku Michael Hammer opublikował w HBR słynny artykuł "Reengineering Work: Don't Automate, Obliterate". Jego teza jest dziś bardziej aktualna niż kiedykolwiek: jeśli nałożysz AI na nieefektywny, biurokratyczny proces, jedynym efektem będzie to, że będziesz popełniać błędy szybciej i na większą skalę.

Wdrożenie RAG i agentów to szansa na "unicestwienie" starych form pracy. Zamiast wielostopniowych zatwierdzeń, systemy agentowe mogą w czasie rzeczywistym weryfikować zgodność z polityką firmy (dzięki RAG), co pozwala na drastyczne skrócenie cykli decyzyjnych. Przykładowo, w sektorze usług sieciowych, wdrożenie agentów zdolnych do samodzielnej analizy usterek i sugerowania napraw skróciło czas przestojów o 30% i podniosło satysfakcję klientów o 40%.

FAQ: Architektura Nowej Wydajności w Erze AI

Dlaczego dzisiejsze modele LLM porównuje się do XIX-wiecznego silnika parowego?

Podobnie jak centralny silnik parowy, generyczne modele LLM dysponują ogromną mocą, ale są "odizolowane" od specyficznych potrzeb poszczególnych stanowisk pracy. Silnik parowy wymagał skomplikowanego systemu wałów i pasów, by przekazać moc; LLM wymaga od pracownika ręcznego "przepisywania" kontekstu firmy w promptach. Prawdziwa rewolucja (odpowiednik silnika elektrycznego "Unit Drive") następuje dopiero wtedy, gdy AI zostaje rozproszona i osadzona bezpośrednio w procesie za pomocą technologii RAG.

W jaki sposób technologia RAG eliminuje problem halucynacji AI?

RAG zmienia model działania AI z „zamkniętej księgi” (poleganie tylko na pamięci modelu) na model „otwartej księgi”. Zanim AI udzieli odpowiedzi, system przeszukuje bazę wewnętrznych dokumentów firmy (instrukcje, raporty, procedury) i dostarcza je modelowi jako jedyne źródło prawdy. Dzięki temu każda informacja ma swoje źródło w faktach firmowych, co pozwala na pełną weryfikowalność i redukuje ryzyko zmyślania faktów.

Jaka jest różnica między zwykłym chatbotem a agentem AI?

Chatbot jest reaktywny – odpowiada na pytania, gdy zostanie o to poproszony. Agent AI jest proaktywny i posiada zdolność do rozumowania, planowania oraz samodzielnego korzystania z narzędzi (np. CRM, API czy systemy logistyczne) w celu osiągnięcia celu. Agenci działają jak samodzielne „mikro-silniki” na konkretnych stanowiskach pracy, potrafiąc między innymi samodzielnie zweryfikować usterkę i zaplanować jej naprawę.

Dlaczego mimo inwestycji w AI nie widzę natychmiastowego wzrostu produktywności?

To zjawisko nazywane „podatkiem od wdrożenia” (Implementation Tax) lub „Krzywą J” adopcji technologii. Historia elektryfikacji pokazuje, że samo zastąpienie starego napędu nowym (np. silnika parowego jednym dużym silnikiem elektrycznym) nie zmienia wydajności, jeśli nie zmieni się układu pracy. Firmy często odnotowują przejściowy spadek rentowności (np. o ok. 428 punktów bazowych w sektorze bankowym) podczas absorpcji kosztów integracji i rekonfiguracji systemów.

Czy automatyzacja procesów za pomocą agentów AI wyeliminuje pracę ludzi?

Strategiczne podejście zakłada augmentację (wsparcie), a nie tylko automatyzację (zastąpienie). Podczas gdy AI przejmuje zadania powtarzalne i wymagające analizy ogromnych zbiorów danych, rola człowieka przesuwa się w stronę frameworku EPOCH – empatii, fizycznej obecności, wydawania sądów moralnych, kreatywności i budowania wizji (Leadership). AI „odciąża” pracowników z administracyjnego „szumu”, pozwalając im skupić się na decyzjach o wysokiej wartości strategicznej.

Jakie są największe bariery we wdrażaniu autonomicznych systemów AI?

Głównym problemem nie jest technologia, lecz brak zaufanych danych i gotowości infrastrukturalnej. Zaledwie 6% firm w pełni ufa agentom AI w zarządzaniu kluczowymi procesami. Liderzy wskazują na fragmentację danych (silosy), obawy o cyberbezpieczeństwo (43%) oraz brak precyzyjnych reguł zarządzania (governance), które pozwoliłyby maszynom działać w sposób bezpieczny i przewidywalny.

Podsumowanie i Rekomendacje Strategiczne

Przejście od generycznego AI do systemów uziemionych (RAG) i autonomicznych (Agentic AI) to nie jest tylko kolejna aktualizacja oprogramowania. To zmiana paradygmatu, która wymaga od kadry zarządzającej odwagi do przebudowy samej "hali fabrycznej" nowoczesnego biura.

- Porzuć model "Centralnej Pary": Publiczne chatboty są świetne do nauki, ale w skali przedsiębiorstwa są jak silnik parowy – generują energię, ale nie tworzą precyzyjnej wartości. Twoim celem powinna być własna, uziemiona baza wiedzy.

- Inwestuj w RAG jako fundament zaufania: Nie pozwól AI zgadywać. Daj jej dostęp do dokumentów firmowych przez architekturę RAG, co zlikwiduje halucynacje i przywróci kontrolę nad faktami.

- Buduj sieć rozproszonych silników (Agentów): Zidentyfikuj procesy, w których inteligencja może działać autonomicznie. Zacznij od agentów wspierających (advisory), by docelowo przejść do agentów wykonawczych (executive), działających w ramach zdefiniowanych barier zaufania.

- Zmień strukturę pracy, a nie tylko narzędzia: Największy zysk z elektryfikacji nie przyszedł z faktu, że silnik był tańszy od konia, ale z faktu, że fabryka mogła zostać zaprojektowana od nowa. Wykorzystaj AI, by "unicestwić" zbędne kroki w swoich procesach.

Rewolucja wydajności nie wydarzy się automatycznie przez sam fakt posiadania dostępu do najnowszych modeli LLM. Wydarzy się wtedy, gdy każda komórka organizacji otrzyma swój własny, precyzyjny silnik inteligencji, zasilany czystymi danymi i uziemiony w realiach biznesu. To jest moment "Unit Drive" dla XXI wieku. Ci, którzy to zrozumieją, przestaną płacić "podatek od wdrożenia" i zaczną czerpać dywidendę z prawdziwej cyfrowej transformacji. W Robosourcing pomagamy w transformacji cyfrowej, wdrażaniu robotyzacji, baz wiedzy RAG i augmentacji.